Adobe近日宣布对其人工智能视频生成工具Firefly进行重大功能升级,推出基于文本指令的精准视频编辑器,并引入多款第三方模型以增强生成能力。此次更新标志着Firefly从单一生成工具向综合创作平台的转型,用户可通过自然语言指令直接修改视频元素、色彩及镜头运动,无需重新生成整个片段。

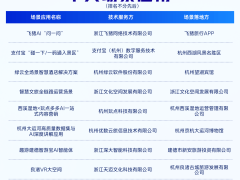

新编辑器核心功能包括时间轴视图与精细化指令控制。用户可通过文本输入调整画面帧、音频同步及视频属性,例如“将主体放大20%”或“降低背景亮度”。该功能已于10月完成私密测试,现向所有用户开放。Adobe表示,通过集成Runway的Aleph模型,编辑指令可实现更复杂的视觉效果,如天气模拟与色彩分级。

在镜头运动复刻方面,Firefly Video模型支持用户上传起始帧与参考视频,自动生成匹配的运镜轨迹。这一功能适用于需要保持风格统一的系列视频制作,例如广告片或短视频内容。同时,Topaz Labs的Astra模型被引入以提升视频分辨率,用户可将素材直接升级至1080P或4K标准。

图像生成领域,Black Forest Labs的FLUX.2模型即日起登陆Firefly全平台,Adobe Express用户则需等待至明年1月方可使用。该模型以高细节表现力著称,可生成逼真的场景与物体。协作画板功能同步上线,支持多用户实时编辑同一项目,提升团队工作效率。

为应对市场竞争,Adobe推出限时订阅福利:截至明年1月15日,Firefly Pro、Premium及积分套餐用户可无限次使用所有图像与视频生成模型。此举旨在巩固用户粘性,同时展示其技术整合能力。今年以来,Firefly系列已陆续推出网页版、移动应用,并持续扩展第三方模型库,形成覆盖多场景的创作生态。

行业观察人士指出,Adobe通过开放生态策略,将自研模型与第三方技术结合,既保持了核心控制力,又满足了用户对多样化工具的需求。此次更新或进一步加剧AI视频生成领域的竞争,推动行业向更高效、智能的方向发展。