字节跳动旗下Seed团队近日宣布,其研发的原生全双工语音大模型Seeduplex正式上线豆包App,并面向全体用户开放。这一突破标志着语音交互技术从实验室走向规模化应用,用户无需等待内测或灰度发布,即可直接体验“边听边说”的流畅对话模式。

传统语音交互常因“抢话”“卡顿”或环境噪音干扰被诟病为“机械感强”。Seeduplex通过两项核心技术突破解决了这一痛点:其一,动态判停技术使模型能结合语音特征与语义状态,精准判断用户是“思考中”还是“已说完”,抢话比例较传统模型降低40%;其二,精准抗干扰能力通过直接解析原始音频信号,在咖啡厅、车站等嘈杂场景中,误回复率与误打断率减少一半。实测显示,用户即使中途打断对话或插入其他指令,系统也能自然衔接上下文,例如在点咖啡时暂停行程讨论,模型会主动询问是否需要复述推荐内容。

在极限场景测试中,Seeduplex展现了接近人类对话的节奏感。当用户参与“飞花令”游戏时,模型几乎实现零延迟响应,甚至能识别用户“套娃”重复诗句并即时提醒;在模拟英文面试中,面对用户长达5秒的“um…uh…”卡顿,模型未强行插话,而是耐心等待完整回答后再提出下一个问题。这种“懂分寸”的交互体验,源于模型对语调、呼吸节奏等人类无意识信号的深度学习,而非单纯依赖静音时长判断。

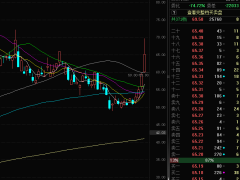

技术实现层面,Seeduplex摒弃了传统“语音转文字→大模型处理→文字转语音”的三段式架构,采用端到端原生设计,使模型直接从音频信号中学习语音与语义的一体化表达。工程团队通过重构模型框架、升级训练体系、优化推理性能等手段,在保障低延迟(判停延迟降低约250ms)的同时,将服务稳定性提升至亿级用户并发场景。横向对比显示,其对话流畅度MOS分较上一代提升12%,复杂场景下响应准确率与打断响应速度均领先行业主流应用。

该技术的落地不仅提升了消费级产品体验,更为车载、教育、客服等高频场景开辟了新可能。例如,在驾驶场景中,系统需在复杂声学环境中快速识别用户指令;在教育领域,口语陪练模型需理解学生的犹豫与思考过程;在客服场景中,系统需在多人对话中稳定主线交互。Seeduplex的产业价值在于,它将过去局限于演示场景的全双工技术,推向了需要高鲁棒性与实时性的真实世界。

从行业演进视角看,语音交互正经历从“回合制问答”到“实时自然交流”的关键跨越。早期级联模型因各模块独立优化导致体验割裂,端到端实时语音技术虽降低了延迟,却仍未能解决对话节奏控制的核心问题。Seeduplex的突破在于,它首次将“对话流控制能力”——即何时听、说、停、等——纳入模型训练,使AI从被动响应工具进化为具备主动交互意识的伙伴。这一转变或可类比GPT-3.5对文本交互的革新:当机械感被消除,技术才能真正融入日常生活。